大数据理论与技术创新 数据处理的演进与突破

在数字时代,大数据已成为驱动社会进步与经济发展的核心引擎。从理论奠基到技术创新,数据处理作为大数据价值实现的关键环节,正经历着深刻的变革与飞跃。本文将探讨大数据理论的发展脉络,并聚焦于数据处理领域的技术创新,展望其未来趋势。

一、大数据理论的演进:从概念到范式

大数据理论并非一蹴而就,其发展经历了从概念萌芽到系统化范式的演进过程。早期,大数据主要被视为数据量的爆炸式增长,“3V”模型(Volume体量、Velocity速度、Variety多样性)成为其经典定义。理论不断深化,扩展至“5V”(增加Value价值与Veracity真实性),强调数据的内在质量与潜在效用。

在理论层面,大数据推动了传统统计与计算范式的革新。例如,采样理论面临挑战,全量数据分析成为可能;因果关系与相关关系的讨论日益深入,数据驱动决策逐渐成为主流思维。复杂性科学、信息论等学科与大数据交叉融合,为理解海量、高维、动态的数据系统提供了新的理论框架。这些理论不仅解释了大数据现象,更指导着技术发展的方向。

二、数据处理技术的创新:架构、算法与工具

数据处理是将原始数据转化为洞察与价值的过程。随着数据规模与复杂度的攀升,相关技术持续创新,主要体现在以下几个方面:

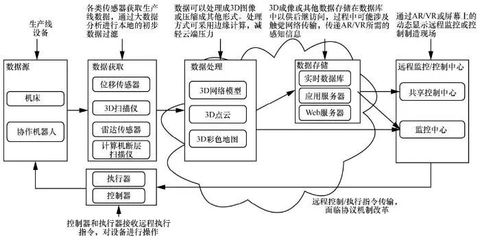

- 计算架构的革新:从集中式的数据仓库到分布式的处理框架,计算架构的演进是支撑大数据处理的基础。Apache Hadoop的MapReduce范式开启了分布式批处理的新时代,而Apache Spark凭借内存计算和DAG执行引擎,显著提升了迭代计算和实时分析的性能。如今,流处理框架如Apache Flink和Apache Kafka Streams实现了低延迟的实时数据处理,满足了物联网、金融风控等场景对即时性的严苛要求。云原生与无服务器架构的兴起,进一步提供了弹性、可扩展且成本优化的数据处理环境。

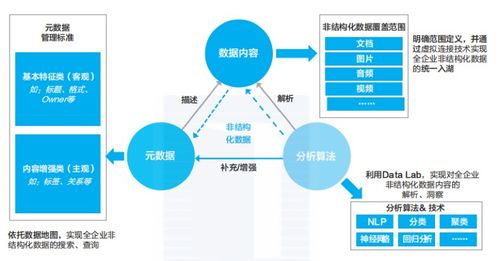

- 存储与管理的进化:数据存储从关系型数据库的单一模式,发展为包括NoSQL(如键值存储、文档数据库、列族存储、图数据库)、NewSQL以及数据湖在内的多元化体系。数据湖技术允许以原始格式存储海量异构数据,实现了存储与计算的解耦,为后续的灵活分析奠定了基础。元数据管理、数据目录和数据治理工具的完善,则确保了数据在复杂管道中的可发现性、可理解性与可信度。

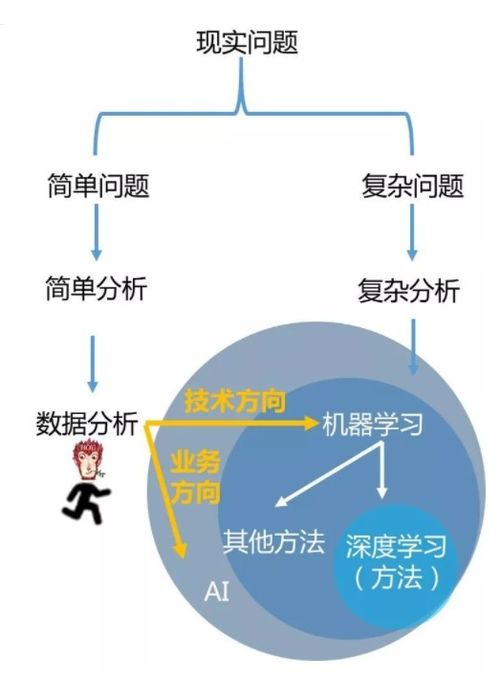

- 处理算法的智能化:传统的数据处理侧重于ETL(抽取、转换、加载),而现代处理流程日益融入机器学习和人工智能。自动化的特征工程、嵌入式的模型训练与推理、以及联邦学习等隐私计算技术,使得数据处理过程不仅能清洗和整合数据,更能直接提取深层模式与智能。例如,在数据清洗阶段,可利用机器学习算法自动检测异常和修复缺失值。

- 工具生态的繁荣:从开源的Apache项目生态(如Hive、Pig、Beam)到商业化的云平台服务(如AWS Glue、Google Dataflow、Azure Databricks),数据处理工具链日益丰富和易用。低代码/无代码平台的出现,降低了数据处理的技术门槛,让业务分析师也能参与构建数据管道。

三、未来展望:融合、实时与可信

大数据处理技术将朝着更深度的融合、更极致的实时与更坚实的可信方向发展。

- 融合化:批流一体(Unified Batch & Stream Processing)将成为标准,数据湖与数据仓库的边界模糊,形成湖仓一体(Lakehouse)架构,兼顾灵活性与性能。数据处理与AI工作流的融合将更加紧密,形成从数据到洞察的自动化闭环。

- 实时化:随着边缘计算的普及,数据处理将更多地向数据源头靠近,实现边缘智能与实时响应,满足自动驾驶、工业互联网等场景的毫秒级决策需求。

- 可信化:数据安全、隐私保护与伦理规范将深度嵌入数据处理全生命周期。差分隐私、同态加密、可信执行环境等技术将得到更广泛应用,确保数据在流通与利用中的安全合规。

大数据理论与技术创新的核心在于数据处理能力的持续突破。从理解数据的本质到构建高效、智能、可靠的处理系统,这是一场永无止境的探索。随着量子计算、神经形态计算等新兴技术的发展,数据处理或许将迎来又一次范式革命,为解锁数据宇宙的无穷奥秘开启新的篇章。唯有不断推动理论与技术的协同演进,我们才能充分驾驭大数据浪潮,赋能千行百业的数字化转型与智能化升级。

如若转载,请注明出处:http://www.zzzcvip.com/product/72.html

更新时间:2026-02-25 04:29:43